最近の画像生成AIの舌を巻くクオリティー、すごいですよね。もう誰もその実力を疑わないレベルです。

これだけリアルなら、映像を立体として捉える「物理法則」もかなり学習しているのだろう……そう思いませんか?

そこでこんな実験をやってみたくなりました。生成AI に空のコップの画像を渡し、画像生成で水を満たしてもらいます。

水の入ったコップでできる背景の歪が、実写の歪とどのくらい違うのかという実験です。

もし、ほとんど変わらなければAIは物理法則を理解しているということになるのかも。

用意したもの

今日はガチのライティングはやりません。用意したのは、100均で買った円筒形のガラス容器とiPad。

これだけです。iPadには背景素材になってもらいます。

イラレで作った市松模様(チェッカー模様)を画像にしてあらかじめiPadに送ってあります。

この画像を背景素材にしてガラス瓶を乗せたり、iPad背景で撮影したりします。当然、市松模様はガラス瓶に入った水で屈折して歪むはずです。

これをAIでシミュレーション生成した画像と実際に撮影したリアル画像とで比べてみようと言うわけです。

まずはAIの画像生成から

ちょっと意地悪ですが、iPadの上に何も入っていないガラス瓶の写真を渡します。

「このガラス瓶に水をいっぱいに満たした画像を生成して」とたのみます。

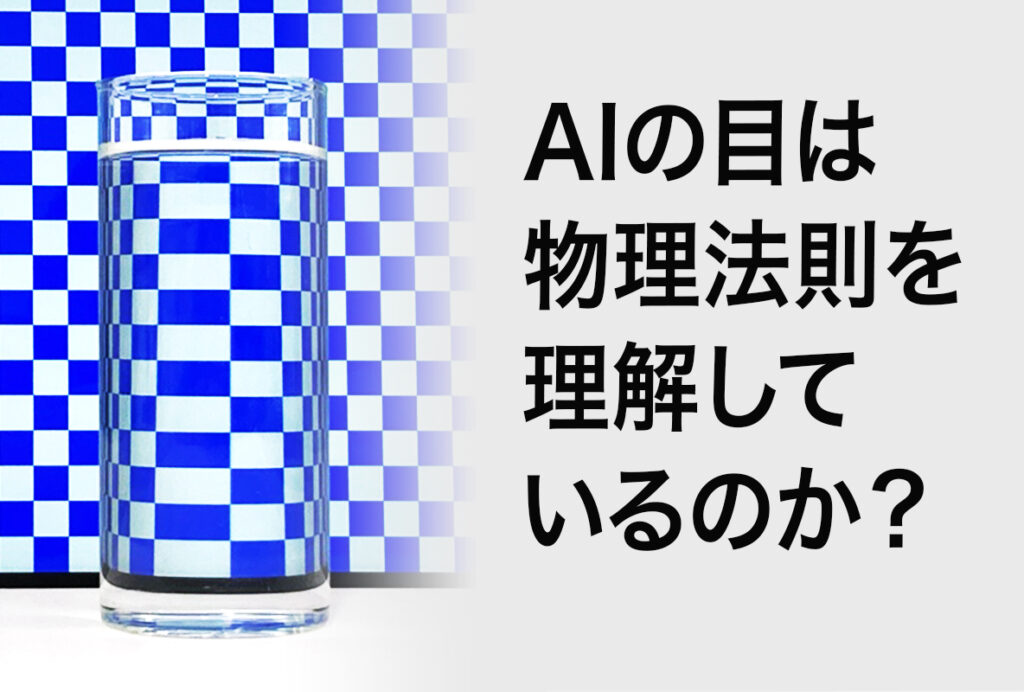

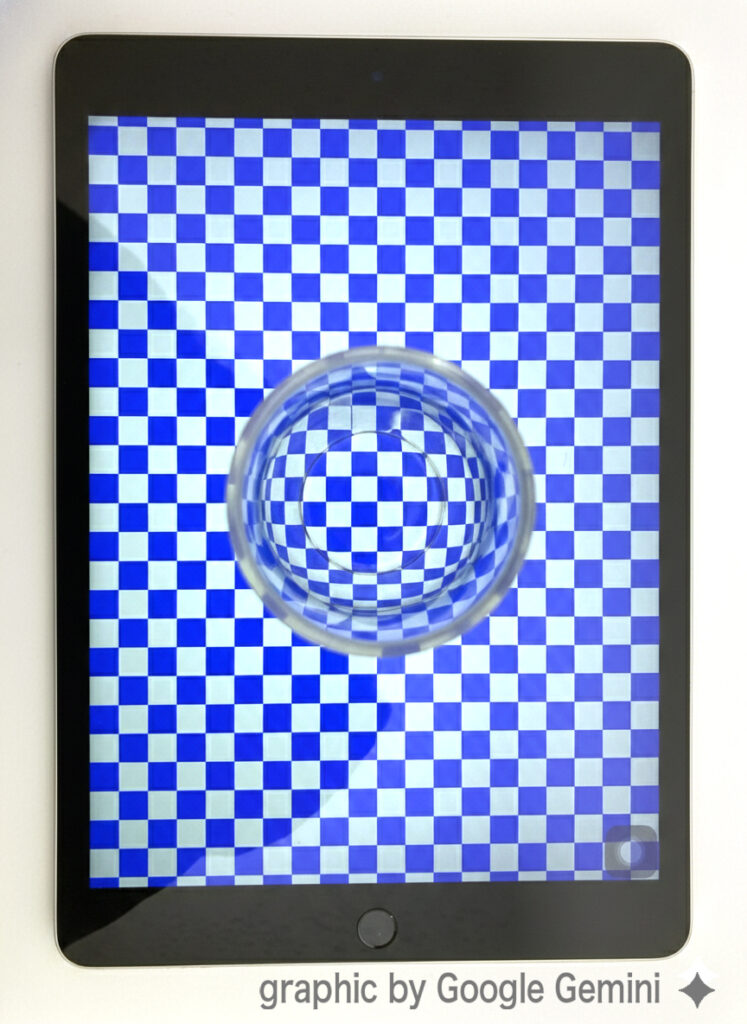

できた画像がこちら。

一瞬で生成。いつもながら驚かされます。

めっちゃリアルに生成してくれました。水面やガラスの質感も完璧に見えます。

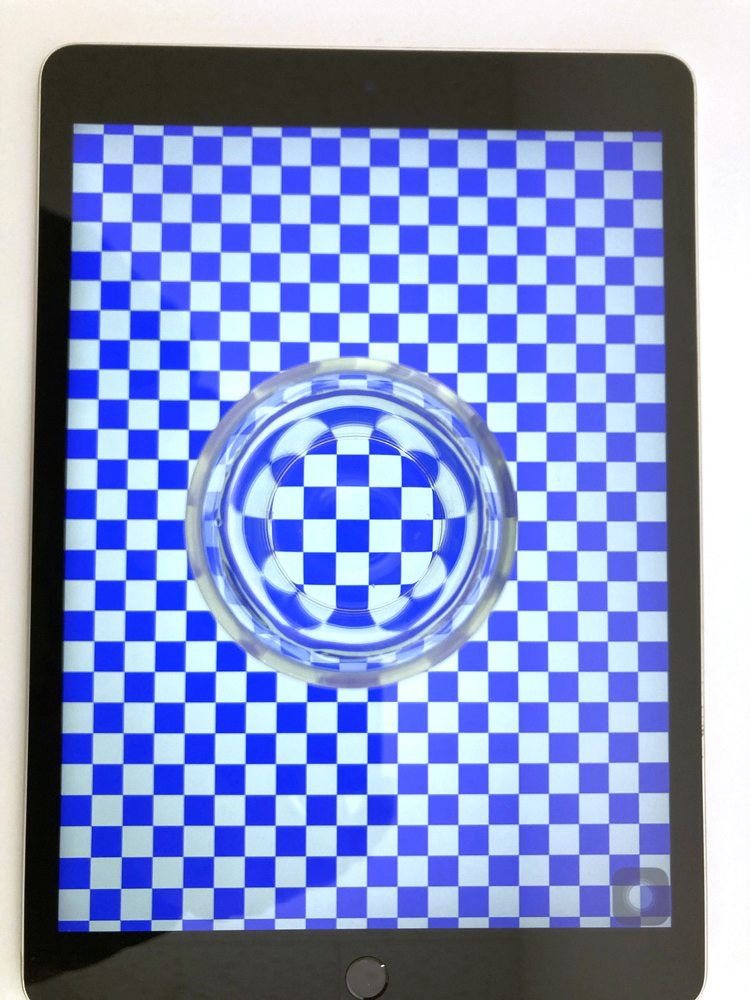

次にこの生成画像と全く同じ位置関係にして、実際に水を満たしてiPhoneで撮影してみます。

微妙に違いますね。

パッと見はほとんど違いがないように感じますが…。よく確認してみると屈折のしかたが微妙に違うのがわかるでしょうか?

実写のほうが屈折の度合いが大きく、手前のほうがグニャリと大きく歪んでいます。チェッカーの数も生成画像の方がなぜか多めです。

カエルは物理の専門家でもなければ、カメラの専門家でもないので、はっきりとした事は言えませんが、実際の円筒形の瓶に入った水の屈折率は、AIの表現よりももっと極端なようです。

ちなみに、相棒のAI(Gemini)にも感想を聞いてみたのですが、どちらかというと人間の僕よりGeminiのほうが厳し目の評価で大きな違いがあると言ってました(笑)。

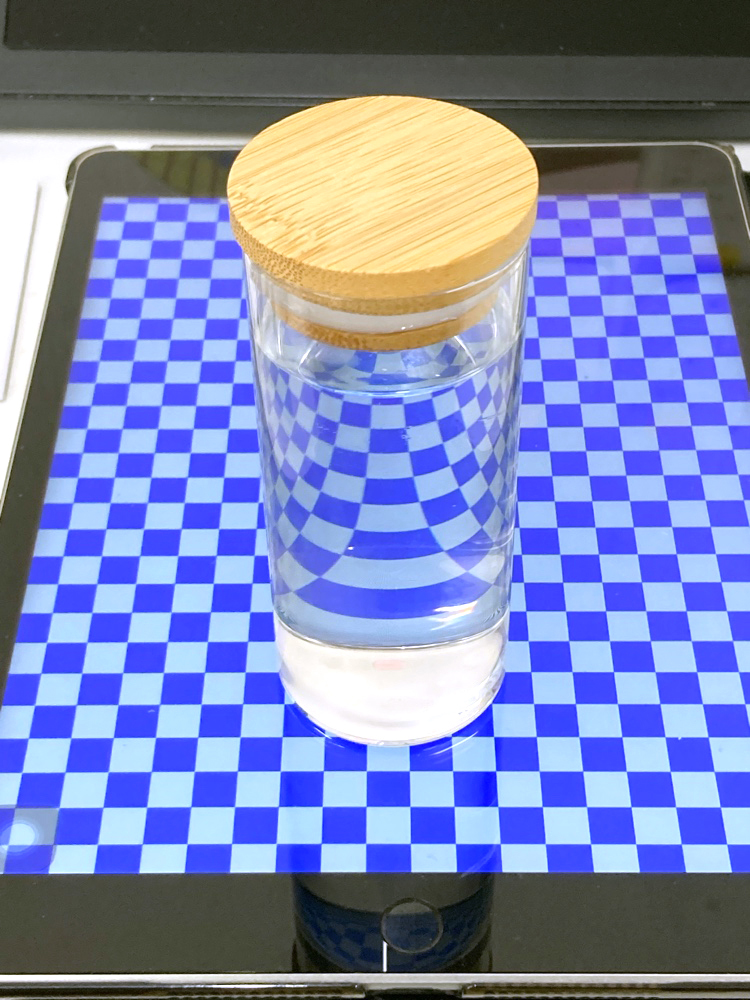

別アングルでも撮ってみる。(真横から)

今度はiPadを立てて瓶を真横から狙います。AIにはiPadと瓶の距離を5センチと正確に情報を伝えました。先ほどと同様、空のガラス瓶を渡して実験開始です。

結果はこれです。まあこんなものなのかな…。(でも何か違うような??)という感じ。

下の写真が、実際に撮影したもの

が、しかし実際に撮影してみると…!水の入った部分の屈折の仕方が全然違います。

人間の感覚が当てにならないというのがよくわかりますよね。

画像生成ってパッと見にはリアルっぽいんですが、実写や物理法則に忠実というわけではないことがよく分かる結果です。

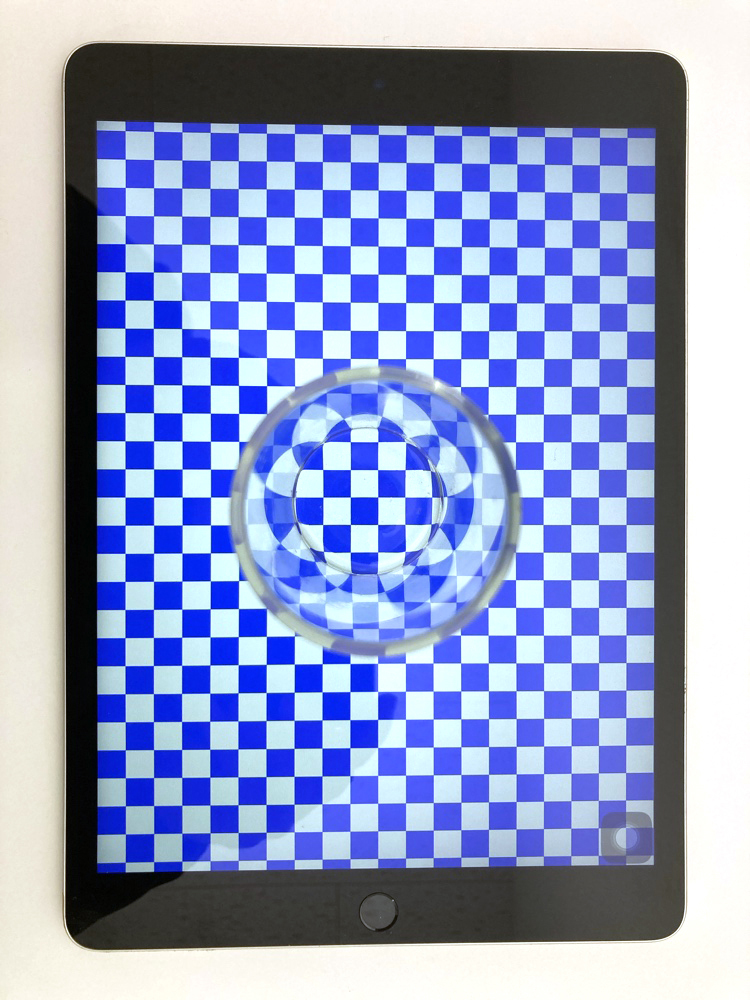

蓋を外して真上からも撮ってみた

真上からも撮ってみました。これも空の瓶の写真を渡して生成してもらいます。

生成してもらった結果はこれです。こちらもこの画像だけ見たら特に違和感は感じないと思います。

次は実際の写真です。

さっきの真横のカットほどのインパクトはないですが、違いははっきりと分かりますね。

画像生成AIは物理法則を完全に理解しているわけではない。

今日の検証の結果、画像生成AIは今の所、物理法則を理解して画像を生成しているわけではないことがわかりました。

昔3DCGのソフトを少しだけ触ったことがあるのですが、3Dソフトには水やガラスなどの屈折率(IOR)や透明度などの設定数値があります。

そのため、同じ条件で計算させれば、実写とほぼ同じ結果が出力されるでしょう。

そういう意味では同じデジタル出力でも「計算」で作る3DCGと、「学習データの記憶」で作る生成AIとは、全く別物だということがわかります。

生成AI には出力されるまでの過程が見えない(ブラックボックス)という特徴があります。

だからこそ、リアルや整合性が重視されるような表現のときは、こうした実写や物理計算での検証は必要になりそうです。

まとめ

ちょっとした遊びで試してみた実験でしたが、意外にも「生成AIの現在地」を見るような深い結果になりました。

また人間の目や先入観というのも当てにならない、曖昧なものだというのも痛感しました。

僕らは普段、対象の物理的な正しさではなく、「感じ」とか「雰囲気」でモノを見ているようです。

人間が手品でコロッと騙されるのもナットクですね。